Loin des seuls projets pilotes portés par l’État, l’intelligence artificielle est déjà utilisée au quotidien par de nombreux agents publics. Rédaction de notes, synthèses, courriels : ces usages, souvent informels, révèlent un décalage croissant entre les cadres officiels et la réalité du travail administratif.

Article 2/3 – Série « IA et fonction publique »

Une adoption qui précède les cadres

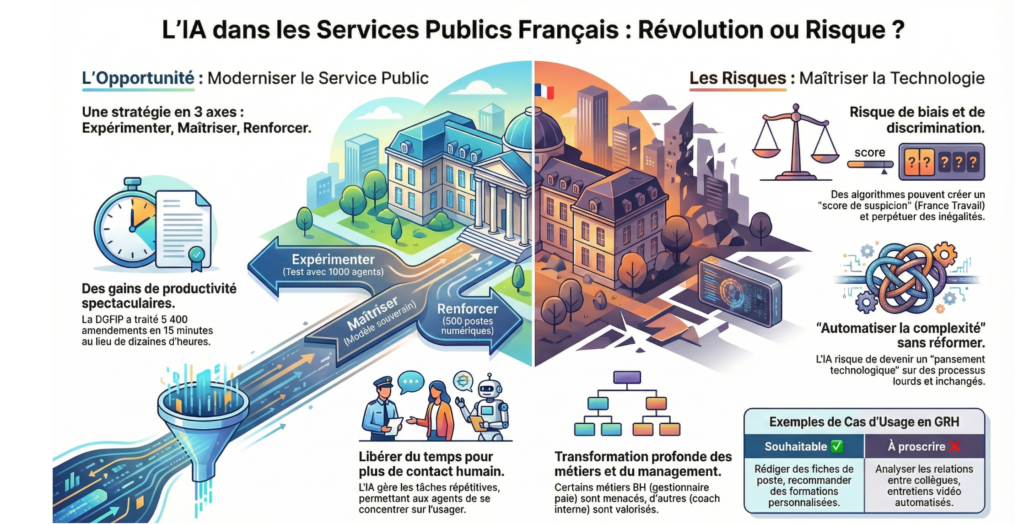

Dans le premier article de cette série, nous avons analysé la stratégie officielle de l’État en matière d’intelligence artificielle, fondée sur des expérimentations encadrées et un discours volontariste. Cette approche repose sur l’idée d’un déploiement progressif, maîtrisé et contrôlé par l’humain.

Sur le terrain, toutefois, l’IA n’a pas attendu ces cadres pour s’imposer. Dans de nombreux services, des agents ont déjà intégré ces outils dans leurs pratiques quotidiennes, souvent de leur propre initiative. Cette adoption précède les chartes, les formations et les doctrines d’usage, et s’opère dans un flou organisationnel persistant.

Selon les travaux de l’Institut Montaigne, l’administration constitue un terrain particulièrement propice à l’IA générative en raison de la forte intensité textuelle du travail des agents. Notes, rapports, courriels, synthèses ou recherches d’information figurent parmi les usages les plus répandus, bien avant toute formalisation institutionnelle

Le quotidien d’une administration « intensive en écrits »

La fonction publique repose largement sur la production et le traitement de documents. Cette réalité explique la rapidité avec laquelle les outils d’IA générative ont trouvé leur place dans le travail quotidien.

Concrètement, les usages sont variés. Certains agents s’appuient sur l’IA pour produire des documents standardisés, reformuler des textes complexes ou réaliser des synthèses. D’autres l’utilisent pour préparer des comptes rendus de réunion, traduire des contenus ou structurer une recherche documentaire.

Dans un contexte de charge de travail élevée, ces outils apparaissent comme un soutien immédiat, accessible et efficace. Ils s’intègrent aux pratiques existantes sans transformation visible de l’organisation du travail.

Le phénomène du « Shadow AI »

Ces usages relèvent majoritairement de ce que l’Institut Montaigne qualifie de « Shadow AI » : le recours à des outils d’intelligence artificielle grand public en dehors de tout cadre officiel. Il ne s’agit pas d’un phénomène marginal, mais d’une adoption diffuse, souvent silencieuse.

L’étude interprète ce phénomène comme le double symptôme d’un appétit pour l’innovation de la part des agents et d’une absence d’espaces de discussion collectifs permettant d’encadrer ces pratiques. En l’absence de règles partagées, les agents expérimentent seuls, évaluant eux-mêmes les bénéfices et les risques associés à ces outils

Entre gain de temps et isolement professionnel

Les gains de temps observés dans certains services expliquent largement l’attrait de ces usages. À la Direction générale des finances publiques, le recours à un outil d’IA a permis de traiter 5 400 amendements au projet de loi de finances 2024 en 15 minutes, contre plusieurs dizaines d’heures auparavant.

Sur la plateforme Services Publics+, une expérimentation menée auprès de 1 000 agents montre que 68 % des usagers jugent utile une réponse aidée par l’IA, contre 57 % pour une réponse entièrement rédigée par un agent. Ces résultats illustrent l’efficacité perçue de ces outils, tant du côté des administrations que des usagers IA dans la fonction publique.

Mais cette efficacité a un revers. En l’absence de cadre collectif, chaque agent développe ses propres pratiques et ses propres limites. Ce qui relevait autrefois de méthodes partagées devient une affaire individuelle. L’IA, censée améliorer l’efficacité collective, peut ainsi contribuer à un isolement professionnel accru.

Des risques encore mal identifiés

Cette adoption informelle soulève plusieurs interrogations. La première concerne la sécurité des données et la confidentialité des informations traitées. La seconde touche à la fiabilité des contenus produits, dès lors que les usages ne sont ni formalisés ni discutés collectivement.

Plus largement, l’Institut Montaigne souligne le risque d’une transformation silencieuse du travail intellectuel. L’agent peut devenir un simple relecteur ou superviseur de contenus générés par la machine. Sans formation ni accompagnement, cette évolution du métier peut se faire « à l’aveugle », conduisant à une forme de déqualification progressive

Un décalage révélateur

Le contraste est net entre le discours institutionnel, centré sur la maîtrise et l’expérimentation encadrée, et la réalité des usages quotidiens, marquée par l’improvisation et l’autonomie contrainte des agents.

Ce décalage ne traduit pas un échec, mais un désajustement. Il révèle à la fois la rapidité avec laquelle l’IA s’intègre au travail administratif et la difficulté des organisations publiques à accompagner ces transformations en temps réel.

C’est dans cet espace de tension que se jouent les principaux risques et dilemmes éthiques liés à l’IA dans la fonction publique, qu’analysera le troisième et dernier article de cette série.

Sources et documents

– Institut Montaigne, travaux sur l’usage de l’IA générative dans les organisations publiques

– Direction générale des finances publiques (DGFiP), retour d’expérience sur l’analyse des amendements au PLF 2024

– Plateforme Services Publics+, résultats d’expérimentations IA auprès de 1 000 agents

– Direction générale de l’administration et de la fonction publique (DGAFP), enquêtes et cadres d’usage de l’IA

Comment cet article a été produit

Cet article s’appuie sur des documents publics, des rapports institutionnels et des travaux de recherche portant sur l’usage de l’intelligence artificielle dans la fonction publique.

Certains éléments de synthèse ont été élaborés avec l’assistance d’outils d’intelligence artificielle, puis relus, vérifiés et intégrés dans un cadre éditorial indépendant.